The Nanny vs. The Nanny State - Tablet Magazine

ジョン・ロブ とヤコブ・シーゲル著:26/09/2023

略奪的な AI から私たちを救えるのはただ 1 つだけです。それは私たち自身のデータです。

2023年7月14日、ロサンゼルスのNetflixピケットラインに到着するSAG-AFTRA会長で女優のフラン・ドレッシャー氏

ハリウッドが中国からの資金でコミックのリメイクを再利用する中、かつての偉大な文化の都は急落の一途をたどっているように見える。しかし、少なくともある分野では、映画産業は大胆かつ刺激的な未来像を提示している。スタジオのオーナーが人工知能(AI)を使って自分たちの作品を搾取・収奪するのを阻止するためにストライキを起こした脚本家や俳優たちは、AIの爆発的な成長によって引き起こされた新たなデータ戦争の最前線にいる。今年7月、人気シットコム『The Nanny』の元スターで、現在はSAG-AFTRA労組の会長を務めるフラン・ドレシャーは、この危機をこう表現した: 「今、背筋を伸ばさないと、私たちは皆、機械に取って代わられる危険にさらされることになる」。

ドレシャーの言う通りだ。米国と世界経済のいたるところで、企業は人々のデータをストリップマイニングし、それをAIシステムの訓練に使っている。この記事が掲載される2日前、アメリカ脚本家組合はスタジオ側と新たな3年契約で暫定合意に達した。Variety』誌によれば、「コンテンツ制作におけるジェネレーティブAIの使用に関する文言の詳細は、協定を締結する前に両者が取り組んだ最後の項目のひとつだった」という。脚本家たちが5ヶ月に及ぶストライキに終止符を打ったことで、俳優組合は間もなく独自の合意に達する可能性がある。ハリウッドのシャットダウンは、関係者の多くにとって痛みを伴うものであったことは間違いないが、AIに対する保護を確保できない労働者は、はるかに悪い結果を迎えることになると我々は考えている。完全な知覚を持つAIについての終末シナリオは、ハイテク産業にとって良いマーケティング・ギミックであることはさておき、このテクノロジーがもたらす現実的かつ差し迫った危険から目を逸らしている: ターミネーター・ロボットの台頭ではなく、何千万、何億という人々が突然職を失うのだ。

AI技術は以前から存在していたが、日常生活者が理解できる形で機能し始めたのはごく最近のことだ。ChatGPTはSFのようなスーパー・インテリジェンスではないが、さまざまなタスクにおいて、十分な教育を受けた人間や熟練した人間の能力と同等の結果をもたらす。その結果、ここ2、3年の間に立ち上げられた何千もの新しいAI企業は、そのサイトへの毎月のユニークビジターを合わせて何十億人も生み出している。そして、フェイスブックやツイッター、その他のソーシャル・ネットワーキング・サイトの絶大なパワーが示しているように、何十億もの訪問者を生み出すことのできるプラットフォームは非常に価値がある。

ChatGPTのような単体のAIも、医療スクリーニングの自動化から孤独な人々との「交流」まで、あらゆることができる他のアプリケーションに組み込まれたAIも、今後数十年間で数十兆ドルの価値を持つ、これまでに作られた中で最も価値のある技術的人工物になる可能性がある。問題は、AIがデータ大食漢だということだ。AIの訓練に使われるデータ量とそのアウトプットの質には強い相関関係があるため(大量のデータを使えば、多くの質の問題を無視することさえできる)、AIを運用する企業は、常に補充される膨大なデータへのアクセスを必要としている。

つい最近まで、膨大な量のデータを入手するのは比較的簡単だった。AI開発者やプラットフォームは、規制のないフロンティアにおける探鉱者のように、オープンなインターネットから一般に入手可能な情報を奔放に収集した。膨大な量のデータは、単にスクリーンスクレイピングされたり、疑わしい情報源からダウンロードされたり、学術的なアクセス権の下で取得されたりしていた。しかし、AIがその商業的価値を証明した今、何兆ドルもの潜在的収益がかかっているため、ゲートは急速に設置されつつある。

すでにTwitterやReddit、その他の大手サイトでは、企業がデータを収集して収益化するのを防ぐため、ユーザーから収集した情報へのアクセスを制限している。ツイッターはレート制限を導入し、ユーザーが1日に閲覧できる投稿数に上限を設けた。こうした動きは、こうしたポリシーを押しつけがましく近視眼的だと考えるユーザーからの反発を引き起こした。しかし、実際には、このような障壁を作らないサイトは、他社に無料のリソースやトレーニングの場として扱ってもらうことになる。OpenAIからMidjourneyに至るまで、AIサイト自身でさえ、自社の製品が他のAIの訓練に使われるのを防ぐために制限を設けている。テック企業もまた、データの無許諾利用が自社のビジネスに損害を与えることを示す法的根拠を構築する戦略の一環として、小規模なデータライセンス契約を結んでいる。最後に、ゲッティ・イメージズのような大企業からコメディアンのサラ・シルバーマンのような個人まで、著作権者が大規模なAI企業に対して起こした著作権訴訟の数が増えている。シルバーマンの弁護士は、OpenAIとMetaが違法なTorrentサイトを通じて彼女の本を入手し、彼女の知的財産をAIモデルのトレーニングに使用したと主張している。

技術革新の急激さと、このような事態に備えることへの消極性(この記事の著者の一人は、数年前にこの混乱を回避する方法について米上院で証言している)は、アメリカの社会・経済秩序に連鎖的な悪影響を及ぼす、ゆっくりと進行する災害を生み出している。特に、著作権などの知的財産を保護する過去の方法が、もはや効果的な保護を提供していないことを考えればなおさらだ。問題は、ChatGPTやその競合他社のような大規模言語学習モデル(LLM)AIはコピーを作っているのではなく、人間が本を読んだり、音楽を聴いたり、絵を見たりして学習するのと同じように、既存のデータから「学習」しているということだ。さらに、AIがAIを訓練するために著作権で保護されたデータ(画像、動画、テキスト、音声など)の一時的なコピーを使用しても、著作権侵害とはみなされない。著作権やライセンスに関する主張がこの新しいテクノロジーによって非常に弱くなったからこそ、企業はユーザーから得たデータを保護するために、粗雑なアクセス制限(APIのブロックや料金制限)やライセンス契約(このデータにアクセスする場合は、その使用に関する当社の規則を遵守し、当社に支払うこと)に目を向けているのだ。

データへのアクセスに橋をかけるようなことをすれば、新しいAI企業が高品質のAIを訓練するために必要なデータを入手することはますます難しくなるだろう。このようなシナリオは、現在の情報王たちの手に権力と富を集中させるだけだ。AI分野への初期参入者は、すでにオープンウェブが提供するもので訓練を受けており、競争から十分に守られていることに気づくだろう。ウェブが硬直化するにつれ、AI開発者はニッチなアプリケーションや情報源に目を向け、人々が仕事中に生成するデータを取得するために金を払ったり、人々が公共スペースに立ち入る際にデータを抽出する契約を結んだりするようになるだろう。

現在の傾向が続けば、AIのデータに対する飽くなき需要と、現在のデータビジネスの独占的利益との間の緊張が、インターネットを封建的な風景に変えてしまうだろう。そうする力を持つすべてのサイトやネットワークは、ボットによる「略奪」を防ぐために壁を設置し、ライセンス契約を通じてのみアクセスを許可するようになるだろう。サイトが一般からのアクセスを遮断するにつれて、これらの塀に囲まれた庭園の悪用を発見し、報告することは難しくなるだろう。

この新しいデータ・グラブで最大の損失を被るのは、関係する企業ではない。AIを価値あるものにしているデータを生み出しながら、その利益から切り離されることになる個人である。大手ソーシャル・ネットワークは自社のプラットフォーム周辺に障壁を築くことができるが、一般的なインターネット・ユーザーには、自分の公開行動が収集され、AIに提供されるのを防ぐ技術的手段がない。データ所有権のようなものがなければ、ネット上のほぼすべての人が、自分自身を売るビジネスに身を置くことになる。経済的な対価を受け取るのはごく少数で、大多数の人々にとっては、AI企業からの「支払い」はプラットフォームへのアクセスという形でもたらされるだろう。実際に何かを所有することはないが、メタバースに不法占拠する特権は得られるだろう。

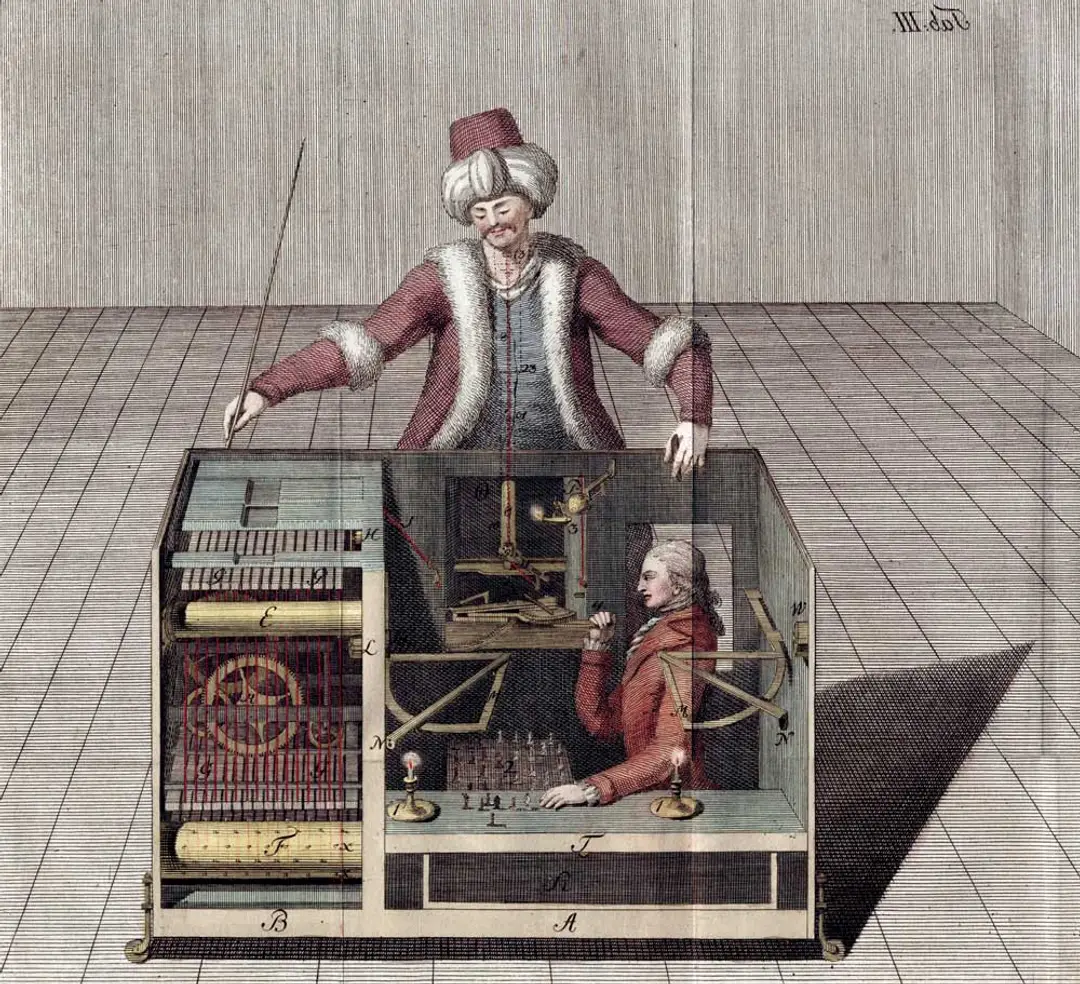

シルバーマンやドレシャーのような俳優が、迫り来る現実として正しく認識しているこの未来では、あなたが購入するすべての商品やサービス、あなたが働く仕事は、あなたがデータを提供し、それに対するすべての権利を放棄することを要求するかもしれない。自分が訓練に協力したAIに仕事が完全に委託されていない個人は、"メカニカル・ターク "と化すだろう。オリジナルのメカニカルタークは18世紀に作られたチェスマシンで、技術的な作為の陰に人間の意思を隠すために作られた手の込んだ策略だった。完全に自動化されたロボットと宣伝されていたが、このマシンのチェスプレイ能力は、隠れた人間の操作によるものだった。最近では、アマゾンが「クラウドソーシング・マーケットプレイス」の名称として「メカニカル・ターク」を採用した。今日、「ターク」という用語は、AIが生成するアウトプットの訓練や修正に使用されるデータを提供する人間の労働者をも指す。

ターキング経済とはどのようなものだろうか? ひとつのシナリオを考えてみよう: 大企業の従業員は、オフィスであろうと、リモートワーカーにとっては自宅であろうと、仕事に分類されるすべての行動についてデータを提供することを余儀なくされる。ビデオ。テキスト。音声。ピーク労働時間、心拍数、その他のバイオマーカー、トイレ休憩の頻度をモニターするセンサーから集められたメタデータ。これらの条件を拒否した労働者は、すでにAIが彼らの業界全体を自動化するよう訓練されており、利用可能な数少ない代替の仕事がさらに悪いものであることに気づく。従業員から収集された情報は、例えば「人間的な」感情を表示するようにプログラムされた接客ボットに声の抑揚や表情を取り入れることで、スキルを複製し、さらには従業員のマナーを模倣するAIを訓練するために使われる。人間の労働者は、AIに代わる新しい労働者にフィードバックを提供することで、そのパフォーマンスを完璧にしたり、足りない部分を補うことができる。

幸いなことに、このシナリオは避けられないものではない。効果的な対応策のひとつのモデルが、ハリウッドのストライカーたちによって提供されている。自分たちの仕事を守るために、脚本家組合と俳優組合は一連の要求を出した。

- 彼らは、仕事中にAIをいつ使うか、あるいは使うかどうかをコントロールしたいのだ。スタジオが彼らの許可なくAIを使って脚本を作成したり、俳優の肖像をコピーして作品に使用したりすることを望んでいないのだ。

- 彼らは自分たちのデータの保護を望んでいる。スタジオがAIを訓練するために自分たちの台本を使用し、スタジオがAIを使って安価に自分たちの作品を複製できるようになることを望んでいないのだ。(現在議論されていないが、これを回避する方法として、スクリプトがAIの訓練に使用された場合、スクリプトを書いた人に寛大かつ永続的なロイヤリティが発生する可能性がある)

- 彼らは "ターキング "の禁止を望んでいる。 この場合、スタジオは、AIによって素早く生成されたスクリプトを "修正 "するために、大幅な割引料金でライターを雇うことを阻止される。AIが生成したキャラクターが使うジェスチャーや表情の一部を "修正 "するために、俳優を低料金で雇うことも同様に禁止されるだろう。

要するに、ギルドの要求は、AIの時代に人間の仕事の価値を維持するための戦略を提供しているのだ。作家や俳優に影響を及ぼす同じ圧力が、事実上、他のあらゆる種類の仕事にも押し寄せようとしている。これらの保護は、私たち全員が求めるべきものであり、今すぐにでも求めるべきものである。間もなく手遅れになるだろう。

Mechanical Turk は 1770 年に作られた詐欺的なチェスプレイマシンで、人間の相手に対して強力なチェスをプレイできるように見えました。ウィキペディア

AIは、自由な社会の将来を懸念する人々にとって計り知れない問題を提示しているが、少なくともひとつの簡単な解決策がある。すべての個人は、保存場所や取得方法にかかわらず、自分が作成したデータに所有権を持つべきである。文章(投稿、ツイート、エッセイなど)、画像(絵であれ、インスタグラムのようなサイトに投稿された写真であれ)、音(音楽から声まで)、映像から生成されたデータは、それらを作成した人間に属するべきである。

最初のステップは、企業がウェブからデータをスクレイピングし、採取している人物の積極的な同意を確保することを義務付けることだ。これには、現在のインターネットのインフラにいくつかの変更を加える必要があるが、大手ハイテク企業がすでにユーザーのキー操作を逐一追跡するための広範な監視システムを採用していることを考えれば、データをその発信元まで遡ることは、多くの人が想像しているよりも簡単かもしれない。新しい要件が設けられる前に開発されたAIシステムや、同意を得ることが不可能なAIシステムは、オープンソース製品としてリリースされなければならない。

抽出やレントシーキングの代わりに所有権に基づくシステムでは、個人はロイヤリティと引き換えにライセンス供与のためにデータをプールすることができる。これは、すでに膨大なデータを集約している大きなサイトには効果的だ。AIによって生み出された価値に基づき、データ貢献に対する標準化されたロイヤルティ率は、市場価格と交渉できない従業員の乱用を最小限に抑えるだろう。ロイヤリティは、データのダイナミックな市場の発展にインセンティブを与え、ウェブを再びオープンにして、現在進行中の損害を逆転させるだろう。

この提案は、一見するとそれほど過激ではない。あなたのデータはすでに価値がある。しかし現在、その価値の恩恵に浴しているのは、データ収集ビジネスに携わるごく少数の企業だけだ。中産階級の完全な消滅を防ぎ、アメリカが自由で民主的な国である可能性を維持するために、次のステップとして必要なのは、労働によって生み出された利益を個人に還元することだ。

やがて、データ所有制度は、金融界で見られるような産業の発展を促すかもしれない。データブローカーや銀行は、可能な限り最高のリターンと保護を得るという受託者責任をもって、個人のために働くだろう。AIが改善され、あらゆる製品やサービスに組み込まれるにつれ、このロイヤリティの支払いは時間の経過とともに相当なものになるはずだ。

個人にデータの所有権を認めるよりも、AIを国有化し、公益事業のようなものとして扱う方がより良い解決策だと主張する人もいる。このアプローチには多くの問題があるが、最も明白なものだけを挙げれば、政府はすでにAIに関与しており、公益を促進するためではなく、政治的な武器としてAIを利用している。この記事の共著者は今年初め、米上院での証言の中で、このダイナミックな動きを取り上げている: 「我々は罠にはまっているようだ。私たちは罠にはまっているようだ。AIの進歩を促進することは極めて重要な国益である。しかし現在、政府によるAIの主な利用方法は、政府またはその第三者パートナーが有害とみなす情報を検閲するための政治的武器となっている。

AIがもたらす必然的な変動や厳しいトレードオフを防ぐ万能薬はない。しかし、劇的な不確実性の瞬間には、過去の教訓を考慮することが役に立つ。封建的な集団主義に似た未来と、初期のリベラルな財産権モデルを模倣した未来とでは、後者の方が大多数の個人にとっても、アメリカ社会の社会構造にとってもより良いものになると私たちは信じている。人々が作成したデータの所有者となることで、科学技術の革新を犠牲にすることなく、プライバシー保護が改善されるだろう。それでもなお、オンライン上で自分の存在を隠したり匿名化したりすることを選ぶ個人もいるだろう。しかし、他の多くの人々は、自分のデータをより信頼できる有用な形に束ね、パッケージ化し、その価値を高めることで、金銭的な報酬を得ることができるだろう。より多くの、より優れたデータが利用可能になることで、新規参入者の多い、競争の激しいAI産業が生まれるだろう。そうなれば、AIサービスのコストは全体的に低下し、データ所有者に提供されるロイヤルティも上昇するだろう。

AIを燃料とする成長経済におけるデータ所有権を通じた参加型平等は、私たちの社会のダイナミズムをより良い方向に変える柔道の一手である。私たちは、未来と技術革新を脅威とみなすことから、私たち全員が利害関係を持つ進歩の機会とみなすようになるだろう。